Le cerveau humain, composé de plusieurs milliards de neurones, a une structure extrêmement complexe. Chaque neurone est connecté à plusieurs milliers d’autres et, à une échelle plus large, le cerveau s’organise dynamiquement autour de véritables autoroutes neuronales reliant des milliers de neurones (liens forts) et de petites routes n’en reliant que quelques-uns (liens faibles). Une équipe de recherche en neurosciences de l’Université Bar-Ilan affirme que, si les liens entre les neurones changent de façon dynamique, les fractions de liens forts et faibles sont constantes. Ces résultats peuvent avoir de nombreuses implications sur la façon dont nous programmons les réseaux neuronaux des intelligences artificielles.

Le cerveau humain est une machine complexe composée par environ dix milliards de neurones. Ceux-ci sont organisés en chaînes dites fortes ou faibles, selon le nombre de neurones qui les composent. Cette organisation, et plus particulièrement les fractions de chaînes fortes et faibles, semblent être communes à chacun d’entre nous, même si les capacités cognitives varient fortement d’un individu à un autre. C’est à cette conclusion qu’est arrivée une équipe de recherche en neurosciences dirigée par Prof. Ido Kanter de l’Université Bar-Ilan. Un des défis modernes des neurosciences est justement de pouvoir identifier l’origine et la fonction de ces liens dont la force varie.

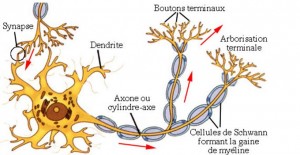

A la suite de travaux de Donald Hebb datant des années 1950, nous avons pensé pendant 70 ans que l’apprentissage se passait exclusivement au niveau des synapses, cette interface entre les boutons terminaux d’un neurone et la dendrite d’un autre (voir image). Contrairement à cette ancienne théorie, l’équipe d’Ido Kanter a montré que l’apprentissage se faisait également dans les dendrites elles-mêmes. Ils ont aussi prouvé que « l’apprentissage dendritique » est beaucoup plus rapide que « l’apprentissage synaptique ».

C’est à l’aide d’études informatiques poussées et en se basant sur leur recherche sur « l’apprentissage dendritique » que l’équipe a découvert l’universalité de la structure dynamique du cerveau. C’est ce dynamisme de l’activité cérébrale qui nous permet par exemple de penser à une nouvelle solution pour un problème donné après y avoir pensé plusieurs fois. De plus, une plus ample compréhension de « l’apprentissage dendritique » pourra dans le futur augmenter les capacités des algorithmes de machine-learning et d’intelligence artificielle.

Publication dans Nature

Rédacteur : Arnaud Courvoisier, doctorant à l’Institut Weizmann, pour le BVST